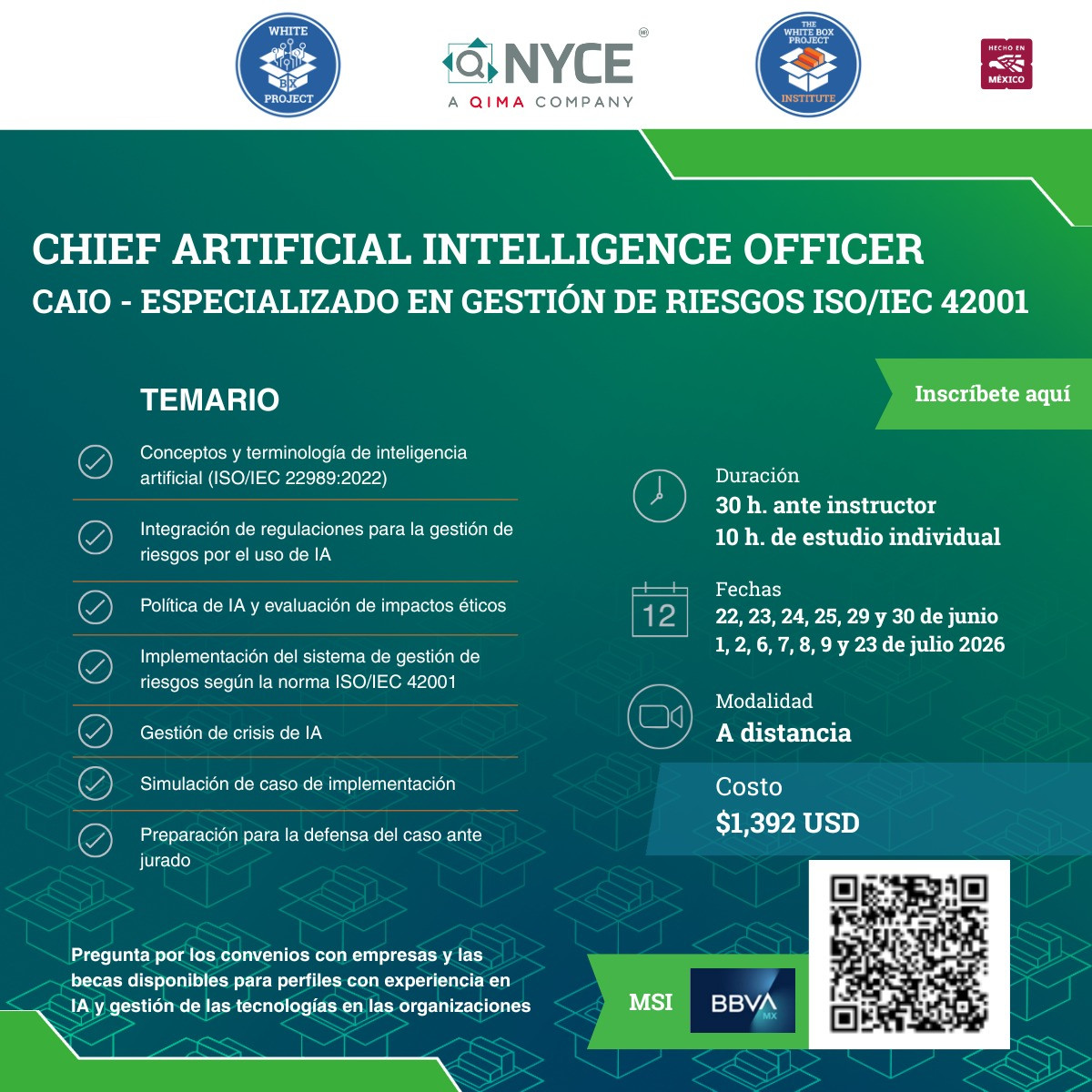

About the course

Objetivo General:

Creado para las empresas que desean contar con un supervisor de inteligencia artificial con los conocimientos necesarios para la implementación de un sistema de gestión de riesgos basado en la norma ISO/IEC 42001:2023 Information Technology – Artificial Intelligence Management System. El curso permite al participante tener los elementos teórico-prácticos necesarios para iniciar el proceso de implementación de un sistema de gestión y, en su caso, la atención de una auditoría realizada por un tercero, con el fin de proteger su modelo de negocio.

¿Quiénes deberían tomar este curso?

Directivos, alta gerencia, auditores, compliance officers y empleados que tengan alguna actividad en:

- Tecnologías de la información

- Despliegue de modelos de Inteligencia artificial

- Consultoría para la gestión de riesgos

- Gobierno corporativo

- Ciencia de datos

- Auditoría

- Programa de integridad corporativa

- Supervisión de sistemas de IA

- Responsables de la gestión de riesgos

- Gobierno (políticas públicas)

- Oficiales en protección de datos y privacidad

- Compliance

Módulos y objetivos del programa

Módulo 1: Conceptos y terminología de inteligencia artificial (ISO/IEC 22989:2022)

Proporcionar una comprensión profunda de los conceptos y la terminología fundamentales de la inteligencia artificial, según la norma ISO/IEC 22989:2022. Los participantes aprenderán a identificar y aplicar estos conceptos en el contexto de la gestión de IA en sus organizaciones y entenderán las tendencias de uso, así como el valor de los datos.

Módulo 2: Integración de regulaciones para la gestión de riesgos por el uso de IA

Objetivo: Comprender cómo las normativas internacionales y las regulaciones locales impactan la implementación y operación de un sistema de gestión de riesgos para IA bajo la norma ISO/IEC 42001. Los participantes aprenderán a integrar los requisitos regulatorios en el marco de gestión de riesgos de IA, asegurando el cumplimiento normativo y la mitigación de riesgos legales.

Módulo 3: Política de IA y evaluación de impactos éticos

Establecer políticas responsables para el uso de la IA y desarrollar capacidades para evaluar los impactos éticos y sociales de los sistemas. Los participantes aprenderán a formular y aplicar políticas de IA, así como a realizar evaluaciones de impacto ético conforme a las mejores prácticas internacionales.

Módulo 4: Implementación del sistema de gestión según la norma ISO/IEC 42001

Desarrollar un sistema integral de gestión de riesgos para la IA, siguiendo los criterios y directrices establecidos en la norma ISO/IEC 42001:2023. Los participantes aprenderán a identificar, evaluar y tratar riesgos asociados con el uso de IA en sus organizaciones.

Módulo 5: Gestión de crisis de IA

Aprender a desarrollar estrategias para la gestión de crisis derivadas del uso de IA, planificando las respuestas ante incidentes. El participante conocerá cómo hacer una comunicación efectiva para el manejo de crisis con todos los stakeholders y el entorno social.

Preparación para la defensa del caso ante jurado

Objetivo: Los participantes, en sesiones grupales, desarrollan su exposición del caso y generan cuatro productos que deben de permitir la implementación del modelo de gestión de IA.

Certificación

Una vez evaluado, el alumno obtiene un documento que lo certifica como Oficial de Cumplimiento en Inteligencia Artificial experto en gestión de riesgos de IA con un enfoque ISO/IEC 42001, emitido por NYCE, Organismo Nacional de Normalización líder en evaluación y certificación en México y con representación en más de 85 países.

Opciones de inscripción

Objetivo General:

Creado para las empresas que desean contar con un supervisor de inteligencia artificial con los conocimientos necesarios para la implementación de un sistema de gestión de riesgos basado en la norma ISO/IEC 42001:2023 Information Technology – Artificial Intelligence Management System. El curso permite al participante tener los elementos teórico-prácticos necesarios para iniciar el proceso de implementación de un sistema de gestión y, en su caso, la atención de una auditoría realizada por un tercero, con el fin de proteger su modelo de negocio.

¿Quiénes deberían tomar este curso?

Directivos, alta gerencia, auditores, compliance officers y empleados que tengan alguna actividad en:

- Tecnologías de la información

- Despliegue de modelos de Inteligencia artificial

- Consultoría para la gestión de riesgos

- Gobierno corporativo

- Ciencia de datos

- Auditoría

- Programa de integridad corporativa

- Supervisión de sistemas de IA

- Responsables de la gestión de riesgos

- Gobierno (políticas públicas)

- Oficiales en protección de datos y privacidad

- Compliance

Módulos y objetivos del programa

Módulo 1: Conceptos y terminología de inteligencia artificial (ISO/IEC 22989:2022)

Proporcionar una comprensión profunda de los conceptos y la terminología fundamentales de la inteligencia artificial, según la norma ISO/IEC 22989:2022. Los participantes aprenderán a identificar y aplicar estos conceptos en el contexto de la gestión de IA en sus organizaciones y entenderán las tendencias de uso, así como el valor de los datos.

Módulo 2: Integración de regulaciones para la gestión de riesgos por el uso de IA

Objetivo: Comprender cómo las normativas internacionales y las regulaciones locales impactan la implementación y operación de un sistema de gestión de riesgos para IA bajo la norma ISO/IEC 42001. Los participantes aprenderán a integrar los requisitos regulatorios en el marco de gestión de riesgos de IA, asegurando el cumplimiento normativo y la mitigación de riesgos legales.

Módulo 3: Política de IA y evaluación de impactos éticos

Establecer políticas responsables para el uso de la IA y desarrollar capacidades para evaluar los impactos éticos y sociales de los sistemas. Los participantes aprenderán a formular y aplicar políticas de IA, así como a realizar evaluaciones de impacto ético conforme a las mejores prácticas internacionales.

Módulo 4: Implementación del sistema de gestión según la norma ISO/IEC 42001

Desarrollar un sistema integral de gestión de riesgos para la IA, siguiendo los criterios y directrices establecidos en la norma ISO/IEC 42001:2023. Los participantes aprenderán a identificar, evaluar y tratar riesgos asociados con el uso de IA en sus organizaciones.

Módulo 5: Gestión de crisis de IA

Aprender a desarrollar estrategias para la gestión de crisis derivadas del uso de IA, planificando las respuestas ante incidentes. El participante conocerá cómo hacer una comunicación efectiva para el manejo de crisis con todos los stakeholders y el entorno social.

Preparación para la defensa del caso ante jurado

Objetivo: Los participantes, en sesiones grupales, desarrollan su exposición del caso y generan cuatro productos que deben de permitir la implementación del modelo de gestión de IA.

Certificación

Una vez evaluado, el alumno obtiene un documento que lo certifica como Oficial de Cumplimiento en Inteligencia Artificial experto en gestión de riesgos de IA con un enfoque ISO/IEC 42001, emitido por NYCE, Organismo Nacional de Normalización líder en evaluación y certificación en México y con representación en más de 85 países.

- Profesor: Administrador Usuario